딥러닝의 역전파 알고리즘 이해 및 적용 사례

F-Lab : 상위 1% 개발자들의 멘토링

AI가 제공하는 얕고 넓은 지식을 위한 짤막한 글입니다!

머리말: 딥러닝의 역전파 알고리즘 소개

딥러닝은 인공지능의 핵심적인 기술로, 다양한 분야에서 활용되고 있습니다. 특히, 역전파(backpropagation) 알고리즘은 딥러닝 모델의 학습을 가능하게 하는 중요한 과정입니다. 왜냐하면 이 알고리즘은 모델의 출력과 실제 값의 차이를 줄이는 방향으로 모델의 가중치와 편향을 조절하기 때문입니다.

이 글에서는 역전파 알고리즘의 이론적 배경과 그 적용 방법에 대해 설명합니다. 그리고 실제 예제를 통해 어떻게 이 알고리즘을 구현하고 활용할 수 있는지 살펴보겠습니다.

역전파 알고리즘은 딥러닝의 기초 이론으로, 신경망의 학습 효율을 극대화하는 데 필수적인 역할을 합니다. 왜냐하면 이 알고리즘을 통해 보다 정확하고 강력한 모델을 구축할 수 있기 때문입니다.

이 글에서는 역전파의 정의와 수학적 자세를 배우고, 이를 기반으로 시켜 학습을 수행하는 구체적인 방법도 다루겠습니다. 예제를 통해 이론이 실제로 어떻게 구현되는지 알아보겠습니다.

시작하기 전에, 딥러닝의 기본 개념과 관련 용어들에 대해 간단히 짚고 넘어가겠습니다. 왜냐하면 기초적인 이해 없이 역전파와 같은 고급 개념을 쉽게 소화하기는 어렵기 때문입니다.

역전파 알고리즘의 기초 이해

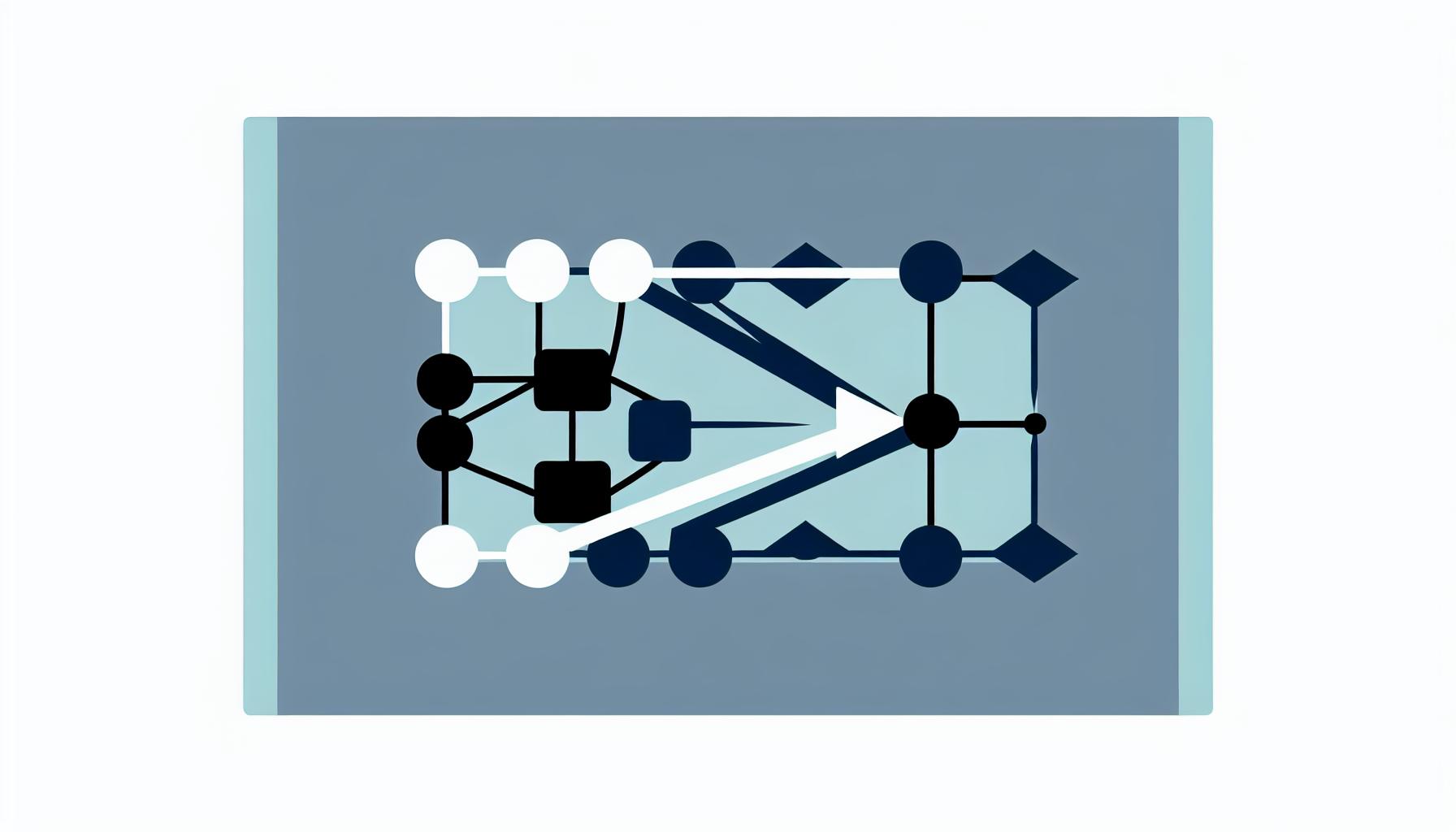

역전파 알고리즘은 다단계로 구성된 신경망에서 각 층의 출력과 정답 간의 오차를 최소화하는 방향으로 가중치를 조절하는 방법입니다. 왜냐하면 이 과정은 신경망의 학습을 가능하게 하며 목표 함수의 최솟값에 수렴하도록 도와주기 때문입니다.

이 알고리즘은 수치 미분을 통해 오차를 계산하고 이를 바탕으로 가중치와 편향을 업데이트하는 방식으로 작동합니다. 왜냐하면 가중치와 편향의 변화가 네트워크의 예측 성능에 직접적인 영향을 주기 때문입니다.

수식으로 표현하면, 가중치의 업데이트는 다음과 같습니다:

W = W - η * ∂L/∂W

여기서 W는 가중치, η는 학습률이고 ∂L/∂W는 손실 함수 L에 대한 W의 편미분입니다. 이 식은 가중치가 손실의 하강 방향으로 업데이트됨을 보여줍니다.

역전파의 핵심은 바로 이 미세한 변화들이 쌓여 보이지 않는 차이를 만들어낸다는 것입니다. 왜냐하면 작은 변화가 누적되며 목표 지점에 이르게 하기 때문입니다.

수치 예제로 보는 역전파의 실전 적용

역전파의 개념을 실전에 적용하기 위해, 우리는 간단한 선형 대수의 예제를 살펴보겠습니다. 왜냐하면 추상적인 수식보다 실제 데이터를 통해 이론을 이해하는 것이 훨씬 직관적이기 때문입니다.

예를 들어, XOR 문제를 풀기 위한 단순한 신경망을 설계해 봅시다. 왜냐하면 XOR 문제는 비선형으로 간단하지만 신경망의 강력한 특성을 테스트하기에 적합하기 때문입니다.

우리는 입력으로 0, 1 비트를 갖는 두 개의 변수를 받아들이고, 출력은 이들의 XOR 결과입니다. 신경망의 순전파와 역전파 과정을 통해 모델의 가중치와 편향이 업데이트 되는 과정을 이해할 수 있습니다.

역전파의 과정에서 중요한 것은 각 층에서 계산된 오차를 다음 층으로 전달하는 것입니다. 왜냐하면 이 과정이 제대로 이루어져야 학습이 원활히 이루어질 수 있기 때문입니다.

이 과정을 코딩으로 구현하면 다음과 같습니다:

inputs = np.array([[0, 0], [0, 1], [1, 0], [1, 1]])

outputs = np.array([[0], [1], [1], [0]])

weights = np.random.rand(2, 2)

bias = np.random.rand(2)

n_epochs = 10000

learning_rate = 0.1

def sigmoid(x):

return 1 / (1 + np.exp(-x))

for epoch in range(n_epochs):

input_layer = inputs

hidden_layer = sigmoid(np.dot(input_layer, weights) + bias)

output_layer = sigmoid(np.dot(hidden_layer, weights) + bias)

# 역전파 과정 생략

심도 있는 역전파의 구현 이론

위에서 본 예제는 매우 단순화된 것이지만, 실제 애플리케이션에서는 보다 복잡한 구조를 가집니다. 왜냐하면 높은 정확도를 요구하는 상황에서는 모델의 복잡성 또한 증가하기 때문입니다.

고급 딥러닝 프레임워크에서는 역전파가 자동으로 수행되지만 기초 이해를 위해 우리가 직접 구현해보는 것이 중요합니다. 왜냐하면 이러한 경험이 이론적 이해도를 높이기 때문입니다.

계산 그래프의 기본 아이디어는 우리의 모델을 평가하는 데 사용될 수 있습니다. 각 단계에서 모든 계산을 기록하고 이를 바탕으로 그라디언트를 계산하는 방식입니다.

다음 단계로 딥러닝의 다양한 구조체, 예를 들어 컨볼루션 레이어나 RNN을 역전파 과정을 통해 학습시키는 부분으로 나아가면 됩니다.

이 모든 과정은 수천 수만 번의 반복을 통해 모델을 점점 더 나은 방향으로 조정하게 됩니다. 왜냐하면 반복되는 훈련이 충분히 이루어져야지만 모델의 수정이 미세해지고, 지도 목표에 부합할 수 있기 때문입니다.

최신 딥러닝 이론과의 연계

딥러닝 모델은 계속해서 진화하고 있으며, 최신 이론과의 연계를 통해 더욱 향상된 결과를 얻을 수 있습니다. 왜냐하면 딥러닝의 생태계는 매우 빠른 속도로 발전하고 있기 때문입니다.

최근에는 트랜스포머와 같은 새로운 아키텍처가 주목받고 있습니다. 이들은 기존의 신경망과 다른 방식으로 학습 효율을 높입니다. 왜냐하면 이 아키텍처는 모든 입출력을 동시에 고려할 수 있기 때문입니다.

딥러닝 연구에서 로그우도 가능도나 크로스 엔트로피 등의 방법론도 중요한 역할을 합니다. 왜냐하면 이들 방법은 모델의 학습 안정성과 목표 도달 속도를 높일 수 있기 때문입니다.

또한, 최적화를 위한 다양한 경량화 기법이 존재하며, 모델의 복잡도를 줄이면서도 성능을 유지할 수 있는 방법들이 연구되고 있습니다.

이와 같은 최신 기술들은 기존의 역전파 알고리즘과 결합하여 보다 뛰어난 성능의 딥러닝 모델을 만들어낼 수 있습니다.

맺음말: 딥러닝과 역전파의 미래

역전파 알고리즘은 딥러닝 기술의 근간이며, 앞으로 더 많은 발전과 응용 가능성을 품고 있습니다. 왜냐하면 딥러닝이 다양한 분야에서 활용되며, 역전파는 그 중심에서 중요한 역할을 해왔기 때문입니다.

기초적인 이해를 바탕으로 실제 문제에 적용할 수 있는 역량을 키우는 것이 중요합니다. 왜냐하면 이론적 지식이 실무에 어떻게 접목되는지를 이해할 때, 그것은 진정한 학습이 되기 때문입니다.

여러분이 현대의 복잡한 문제를 해결하기 위해, 해당 기술을 더욱 탐구하고 발전시키길 바랍니다. 왜냐하면 각자의 노력과 연구가 모여 새로운 혁신을 이루어낼 수 있기 때문입니다.

딥러닝의 잠재력은 무궁무진하며, 그 중심에 있는 역전파 알고리즘을 마스터함으로써 더 나은 미래를 설계할 수 있을 것입니다.

더 나아가, 이는 전문 개발자로서의 능력을 강화하는 데에 큰 도움이 될 것으로 믿습니다. 왜냐하면 다양한 최신 기술과 이론이 결합될 때, 딥러닝은 끝없이 발전하게 될 것이기 때문입니다.

이 컨텐츠는 F-Lab의 고유 자산으로 상업적인 목적의 복사 및 배포를 금합니다.